EUのAI規制案、リスク4段階に分類 産業界は負担増警戒

欧州連合(EU)が人工知能(AI)の利用を制限する包括的な規制案を公表した。個人の自由や権利の保護を重視し、リスクの高いAIの使用には「事前審査」を求める。違反すれば巨額の罰金が科されることになり、産業界では早くも負担増への警戒が広がる。

「新たなAIのルールは『合理化』される必要がある」。EUの欧州委員会が規制案を公表した21日、IT(情報技術)関連企業などで構成する団体「デジタルヨーロッパ」がウェブサイトで懸念の声を上げた。

同団体には独シーメンスや米グーグルといった欧米企業、日本の日立製作所など80社以上が名を連ねる。規制案の公表前から「(個人情報保護の厳格化を求める)一般データ保護規則(GDPR)から教訓を学んだのか」と、コスト負担の増加などに対し、警戒感を示していた。

規制案では人間の生命や基本的な権利に与える影響の大きさをもとに、AIがもたらすリスクを①禁止②高リスク③限定的なリスク④最小限のリスク――という4段階に分類した。

最も厳しい「禁止」は、政府が個人の「格付け」にAIを用いることなどが対象となる。個人の信用度を評価する仕組みとして、中国アリババ集団傘下の金融会社アント・グループが取り入れた「芝麻信用」などが知られる。国家がこうした手法を用いれば、民主主義の根幹が崩れかねないとの判断だ。

警察などが顔認証の技術を使い、公共の場で市民を「常時監視」することも原則禁止になる。顔認証技術は人種や性別によって精度に差が出ると指摘されてきた。米国では2020年の白人警察官による黒人男性暴行死事件を受け、警察による顔認証の利用に批判が集まった。この結果、米アマゾン・ドット・コムなどが関連事業の停止や撤退に追い込まれた。

「高リスク」の対象は幅広い。運輸やガス・水道関連の重要インフラ、教育現場での試験評価、ロボットを使った手術、採用での履歴書管理、ローンなどに絡む信用調査、移民・難民に関わる書類の管理などに使うAIが該当する。

対応は難しい。重要インフラに組み込まれるAIでは、航空や鉄道、エネルギー業界に広く影響が及ぶ可能性がある。採用活動などに使うAIについても、該当する企業は多数にのぼるとみられる。

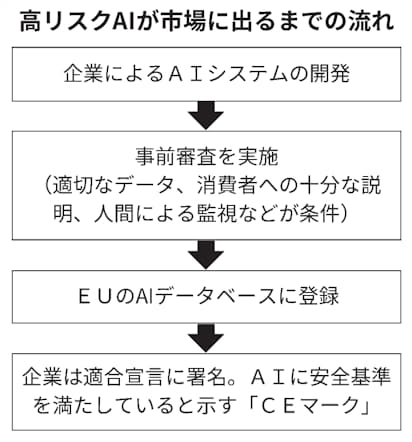

規制案では、こうした利用は第三者機関などの事前審査を経る必要がある。適切なデータの使用や消費者への十分な説明、人間が監視できる仕組み、などが求められ、企業にとっては対応に向けたコストが膨らむ恐れがある。

「限定的なリスク」は、深刻な危険はないAIが分類される。言語分野でAI技術を用いた「チャットボット」のようなシステムが対象となる。企業が消費者からの問い合わせに答える目的などで使っており、人間ではなく「AIが対応している」ことの明示などが必要となる。

最も段階が低い「最小限のリスク」では、既存の法令を満たしていれば追加の対応は必要ない。迷惑メールを除去する目的での用途などが含まれており、欧州委は「大多数のAIはこのカテゴリーに属する」と説明している。

EUは今回の規制を設けることで、AIを巡るルール形成で主導権を握る狙いがあるとみられる。ただ規制案に対しては日本政府内でも「厳しすぎる」と、混乱を危惧する声が上がる。産業界からも反発がさらに強まる可能性がある。

規制案が法律になるには、欧州議会とEUの閣僚理事会の承認が必要だ。一部の欧州議員からは「あいまいな規定が多く、十分な審議が必要」との声が上がっており、成立までには時間がかかりそうだ。

(AI量子エディター 生川暁、ブリュッセル=竹内康雄)

※掲載される投稿は投稿者個人の見解であり、日本経済新聞社の見解ではありません。

この投稿は現在非表示に設定されています

(更新)